- Giới thiệu

-

Lưu trữ dữ liệu đối tượng không giới hạn và truy xuất dữ liệu liên tục

Lưu trữ dữ liệu đối tượng không giới hạn và truy xuất dữ liệu liên tục Certified DBaaS (cơ sở dữ liệu theo dạng dịch vụ) đầu tiên của MongoDB tại Việt Nam

Certified DBaaS (cơ sở dữ liệu theo dạng dịch vụ) đầu tiên của MongoDB tại Việt Nam Tích hợp với máy chủ ảo dành cho 3D Rendering, AI hay ML

Tích hợp với máy chủ ảo dành cho 3D Rendering, AI hay ML Nền tảng phân tích dữ liệu đáng tin cậy cho doanh nghiệp và chuyên gia, giúp tối ưu chi phí vận hành lên đến 40% so với giải pháp BI khác.

Nền tảng phân tích dữ liệu đáng tin cậy cho doanh nghiệp và chuyên gia, giúp tối ưu chi phí vận hành lên đến 40% so với giải pháp BI khác. Sản phẩm hợp tác giữa FPT Cloud và CyRadar, cung cấp dịch vụ tường lửa với khả năng bảo vệ mạnh mẽ cho các ứng dụng web

Sản phẩm hợp tác giữa FPT Cloud và CyRadar, cung cấp dịch vụ tường lửa với khả năng bảo vệ mạnh mẽ cho các ứng dụng web Sản phẩm hợp tác giữa FPT Cloud và CyRadar, dịch vụ cung cấp khả năng rà quét toàn diện, phân tích chi tiết và đánh giá lỗ hổng bảo mật để tăng cường an ninh thông tin cho hệ thống ứng dụng doanh nghiệp

Sản phẩm hợp tác giữa FPT Cloud và CyRadar, dịch vụ cung cấp khả năng rà quét toàn diện, phân tích chi tiết và đánh giá lỗ hổng bảo mật để tăng cường an ninh thông tin cho hệ thống ứng dụng doanh nghiệp Sao lưu và khôi phục dữ liệu tức thời, an toàn và toàn vẹn dữ liệu

Sao lưu và khôi phục dữ liệu tức thời, an toàn và toàn vẹn dữ liệu Trở thành doanh nghiệp đầu tiên trải nghiệm bộ giải pháp phát triển AI toàn diện, được phát triển trên công nghệ mạnh mẽ bậc nhất từ NVIDIA!

Trở thành doanh nghiệp đầu tiên trải nghiệm bộ giải pháp phát triển AI toàn diện, được phát triển trên công nghệ mạnh mẽ bậc nhất từ NVIDIA! Giải pháp làm việc từ xa hiệu quả và an toàn cho doanh nghiệp

Giải pháp làm việc từ xa hiệu quả và an toàn cho doanh nghiệp

Dịch vụ máy chủ ảo tiên tiến với khả năng mở rộng nhanh chóng

Dịch vụ máy chủ ảo tiên tiến với khả năng mở rộng nhanh chóng Hiệu năng mạnh mẽ với hạ tầng riêng biệt

Hiệu năng mạnh mẽ với hạ tầng riêng biệt

Tích hợp với máy chủ ảo dành cho 3D Rendering, AI hay ML

Tích hợp với máy chủ ảo dành cho 3D Rendering, AI hay ML Dịch vụ máy chủ ảo tiết kiệm đến 90% chi phí cho doanh nghiệp

Dịch vụ máy chủ ảo tiết kiệm đến 90% chi phí cho doanh nghiệp Sao lưu và khôi phục dữ liệu tức thời, an toàn và toàn vẹn dữ liệu

Sao lưu và khôi phục dữ liệu tức thời, an toàn và toàn vẹn dữ liệu Dịch vụ dự phòng & khôi phục hệ thống nhanh chóng

Dịch vụ dự phòng & khôi phục hệ thống nhanh chóng Lưu trữ khối đa dạng thông lượng và dung lượng cho mọi nhu cầu

Lưu trữ khối đa dạng thông lượng và dung lượng cho mọi nhu cầu Lưu trữ dữ liệu đối tượng không giới hạn và truy xuất dữ liệu liên tục

Lưu trữ dữ liệu đối tượng không giới hạn và truy xuất dữ liệu liên tục Nâng cao năng lực, tính sẵn sàng của ứng dụng

Nâng cao năng lực, tính sẵn sàng của ứng dụng Sản phẩm hợp tác giữa FPT Cloud và CyRadar, dịch vụ cung cấp khả năng rà quét toàn diện, phân tích chi tiết và đánh giá lỗ hổng bảo mật để tăng cường an ninh thông tin cho hệ thống ứng dụng doanh nghiệp

Sản phẩm hợp tác giữa FPT Cloud và CyRadar, dịch vụ cung cấp khả năng rà quét toàn diện, phân tích chi tiết và đánh giá lỗ hổng bảo mật để tăng cường an ninh thông tin cho hệ thống ứng dụng doanh nghiệp Sản phẩm hợp tác giữa FPT Cloud và CyRadar, cung cấp dịch vụ tường lửa với khả năng bảo vệ mạnh mẽ cho các ứng dụng web

Sản phẩm hợp tác giữa FPT Cloud và CyRadar, cung cấp dịch vụ tường lửa với khả năng bảo vệ mạnh mẽ cho các ứng dụng web Dịch vụ tường lửa thông minh cho các ứng dụng web - Giải pháp bảo mật đột phá với sự hợp tác giữa FPT Cloud và Penta Security.

Dịch vụ tường lửa thông minh cho các ứng dụng web - Giải pháp bảo mật đột phá với sự hợp tác giữa FPT Cloud và Penta Security. Dịch vụ bảo mật tường lửa thế hệ mới

Dịch vụ bảo mật tường lửa thế hệ mới Lưu trữ, quản lý, và bảo mật các Docker Images

Lưu trữ, quản lý, và bảo mật các Docker Images Nền tảng Kubernetes an toàn, bảo mật, ổn định, hiệu năng cao

Nền tảng Kubernetes an toàn, bảo mật, ổn định, hiệu năng cao Tăng tốc phát triển ứng dụng yêu cầu hiệu năng cao bằng dịch vụ Kubernetes tích hợp với vi xử lý cao cấp GPU

Tăng tốc phát triển ứng dụng yêu cầu hiệu năng cao bằng dịch vụ Kubernetes tích hợp với vi xử lý cao cấp GPU Giám sát và triển khai cơ sở dữ liệu như Kafka,..

Giám sát và triển khai cơ sở dữ liệu như Kafka,..

Certified DBaaS (cơ sở dữ liệu theo dạng dịch vụ) đầu tiên của MongoDB tại Việt Nam

Certified DBaaS (cơ sở dữ liệu theo dạng dịch vụ) đầu tiên của MongoDB tại Việt Nam Giám sát và triển khai cơ sở dữ liệu Redis, Cassandra, ...

Giám sát và triển khai cơ sở dữ liệu Redis, Cassandra, ...

Giám sát và triển khai cơ sở dữ liệu xử lý phân tích trực tuyến

Giám sát và triển khai cơ sở dữ liệu xử lý phân tích trực tuyến

Giám sát và triển khai cơ sở dữ liệu MySQL, Postgres, SQLserver, MariaDB,...

Giám sát và triển khai cơ sở dữ liệu MySQL, Postgres, SQLserver, MariaDB,... Giám sát và triển khai cơ sở dữ liệu truy vấn thông tin

Giám sát và triển khai cơ sở dữ liệu truy vấn thông tin

Giám sát và triển khai cơ sở dữ liệu chuỗi thời gian

Giám sát và triển khai cơ sở dữ liệu chuỗi thời gian

Giám sát hệ thống và tài nguyên toàn diện trên mọi nền tảng

Giám sát hệ thống và tài nguyên toàn diện trên mọi nền tảng Giải pháp quản lý sự cố thông minh

Giải pháp quản lý sự cố thông minh Dịch vụ cung cấp giải pháp khởi tạo và quản lý FPT ArgoCD được tạo ra từ dự án mã nguồn mở Argo

Dịch vụ cung cấp giải pháp khởi tạo và quản lý FPT ArgoCD được tạo ra từ dự án mã nguồn mở Argo Nền tảng tự động hoá bảo mật trong quy trình phát triển phần mềm

Nền tảng tự động hoá bảo mật trong quy trình phát triển phần mềm Tăng cường khả năng quản lý tài sản dữ liệu doanh nghiệp

Tăng cường khả năng quản lý tài sản dữ liệu doanh nghiệp Quản lý dữ liệu liền mạch & toàn diện

Quản lý dữ liệu liền mạch & toàn diện Truy vấn, quản lý, trực quan hóa dữ liệu hiệu quả

Truy vấn, quản lý, trực quan hóa dữ liệu hiệu quả Tăng tốc độ xử lý, đảm bảo tính nhất quán cho ứng dụng

Tăng tốc độ xử lý, đảm bảo tính nhất quán cho ứng dụng Nền tảng phân tích dữ liệu đáng tin cậy cho doanh nghiệp và chuyên gia, giúp tối ưu chi phí vận hành lên đến 40% so với giải pháp BI khác.

Nền tảng phân tích dữ liệu đáng tin cậy cho doanh nghiệp và chuyên gia, giúp tối ưu chi phí vận hành lên đến 40% so với giải pháp BI khác. Trở thành doanh nghiệp đầu tiên trải nghiệm bộ giải pháp phát triển AI toàn diện, được phát triển trên công nghệ mạnh mẽ bậc nhất từ NVIDIA!

Trở thành doanh nghiệp đầu tiên trải nghiệm bộ giải pháp phát triển AI toàn diện, được phát triển trên công nghệ mạnh mẽ bậc nhất từ NVIDIA! Nền tảng hội thoại thông minh gắn kết khách hàng trên mọi nền tảng

Nền tảng hội thoại thông minh gắn kết khách hàng trên mọi nền tảng Xác thực nhanh chóng, dễ dàng, tối ưu chi phí

Xác thực nhanh chóng, dễ dàng, tối ưu chi phí Nâng tầm trải nghiệm khách hàng

Nâng tầm trải nghiệm khách hàng

Trích xuất dữ liệu vượt mọi giới hạn

Trích xuất dữ liệu vượt mọi giới hạn

Chuyển văn bản thành giọng nói tiếng Việt với ngữ điệu tự nhiên.

Chuyển văn bản thành giọng nói tiếng Việt với ngữ điệu tự nhiên. - Bảng giá

- Sự kiện

Tất cả tài liệu

Managed GPU Cluster (Kubernetes)

-

Initial Setup

Initial Setup

-

Hướng dẫn chi tiết (Tutorials)

Hướng dẫn chi tiết (Tutorials)

- Quản lý Managed GPU Cluster

- Thay đổi cấu hình K8S Cluster

- Service Type Load-Balancer

- Triển khai mô hình DeepSeek-R1 sử dụng Ollama và Open WebUI

- Hướng dẫn tích hợp File Storage – High Performance

- Slurm on FPTCloud Managed GPU cluster

- VGPU for container

- GPU time sharing

- MPS GPU sharing

- Triển khai workload GPU mẫu lên Managed GPU Cluster

Giới thiệu tính năng time sharing/time slicing trong FPT Kubernetes engine

➤FPT Managed GPU Cluster dựa trên nền tảng mã nguồn mở K8s giúp tự động hoá triển khai, nhân rộng và quản lý các ứng dụng container. FPT Managed GPU Cluster tích hợp đầy đủ các thành phần: Container Orchestration, Storage, Networking, Security, PaaS cung cấp cho khách hàng môi trường tốt nhất để phát triển và triển khai ứng dụng trên Cloud.

➤FPT Managed GPU Cluster cung cấp tính năng time-slicing/time-sharing cho nhiều container/tiến trình trên một Nvidia GPU . Bằng việc sử dụng time-sharing, bạn có thể tối ưu hóa chi phí sử dụng GPU.

➤Trước khi đi vào chi tiết, hãy chắc chắn rằng bạn biết cơ chế hoạt động của time-sharing, bao gồm hạn chế và usecase nào sẽ phù hợp cho tính năng này.

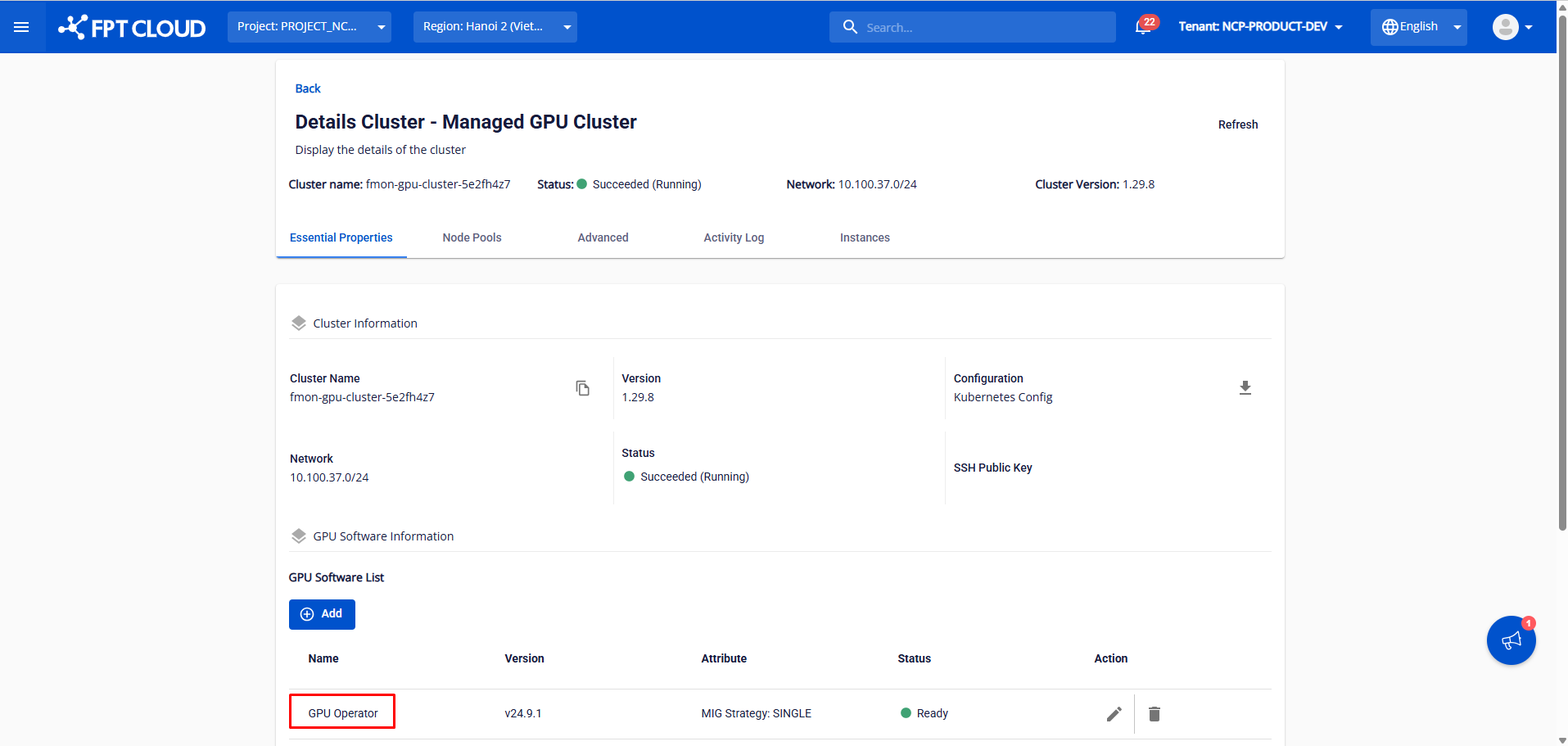

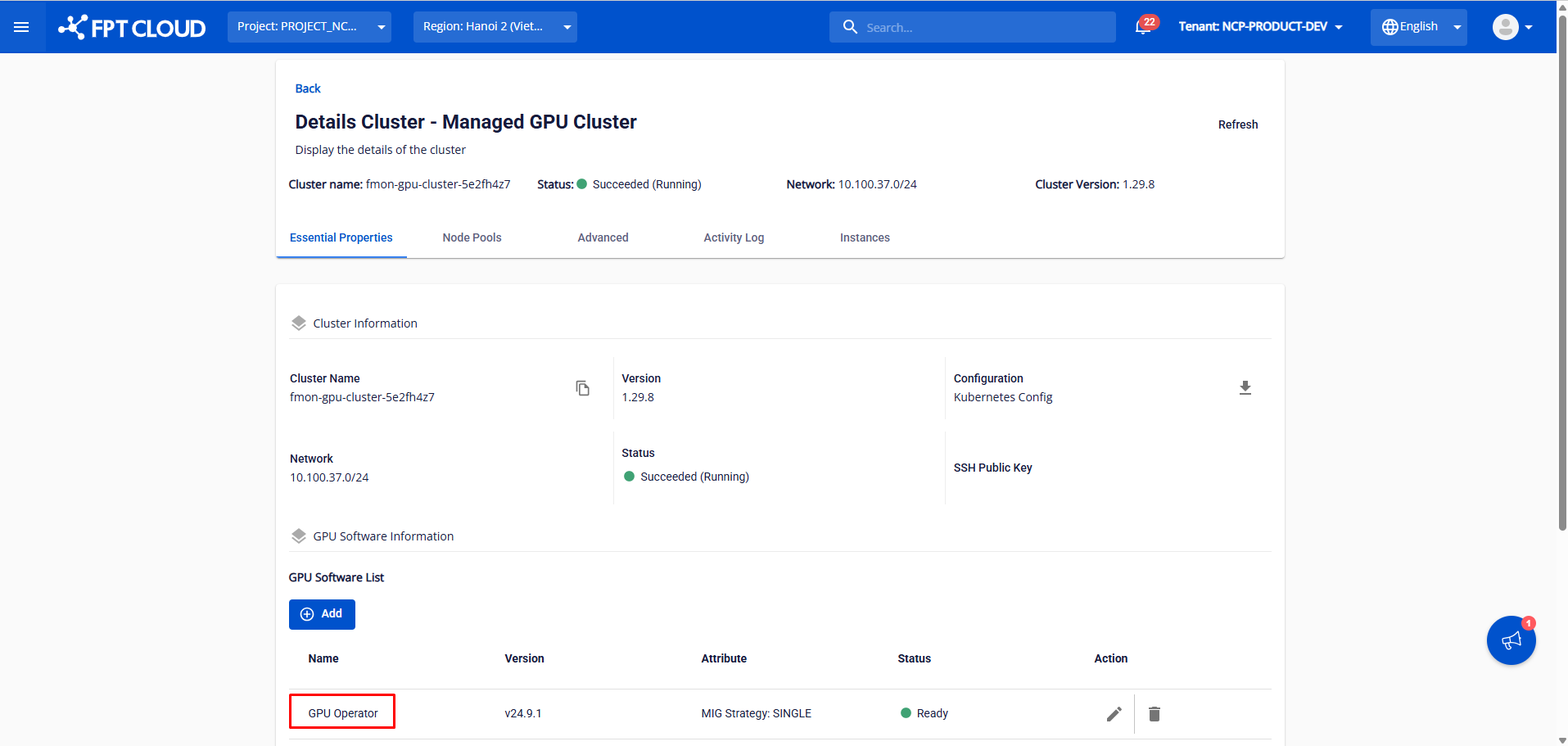

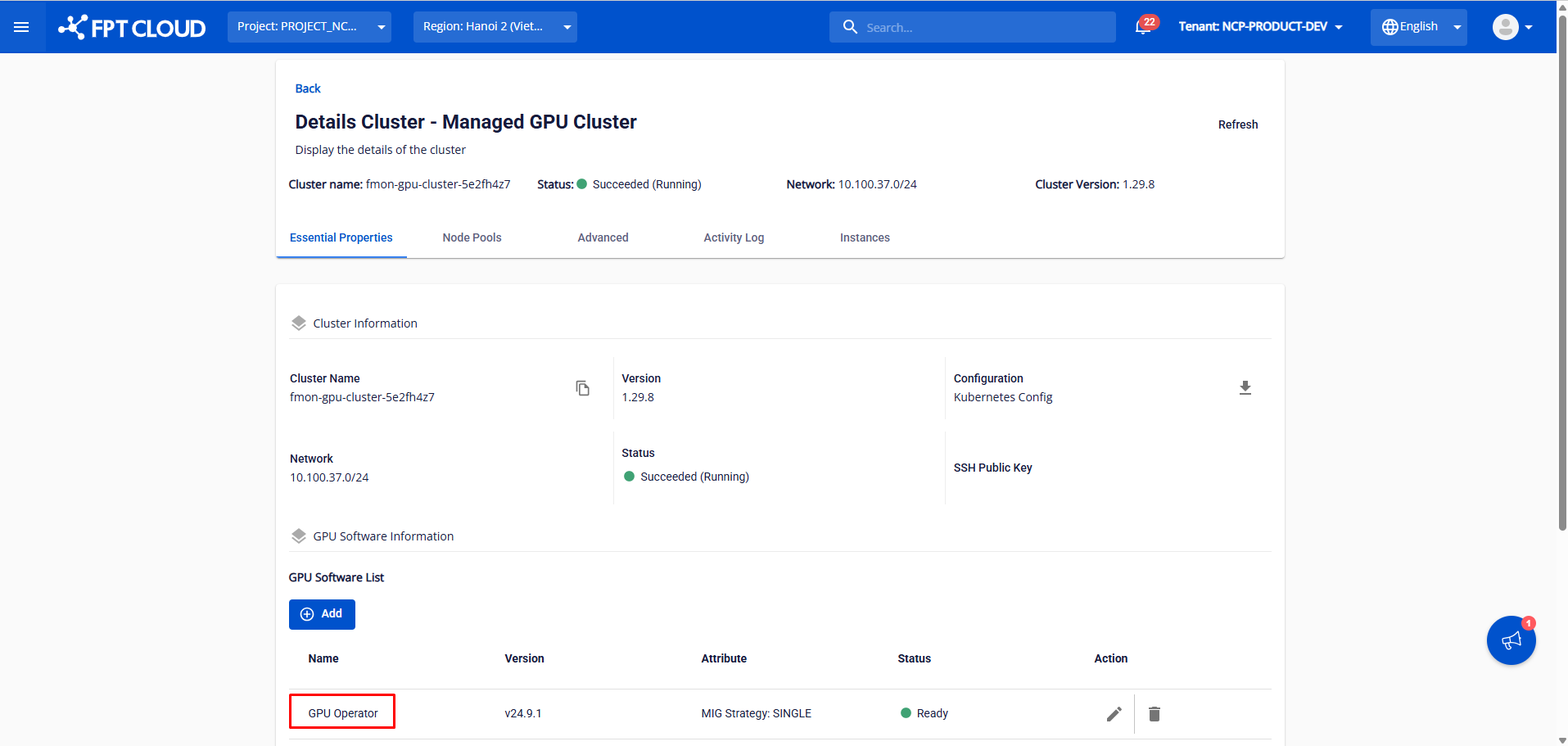

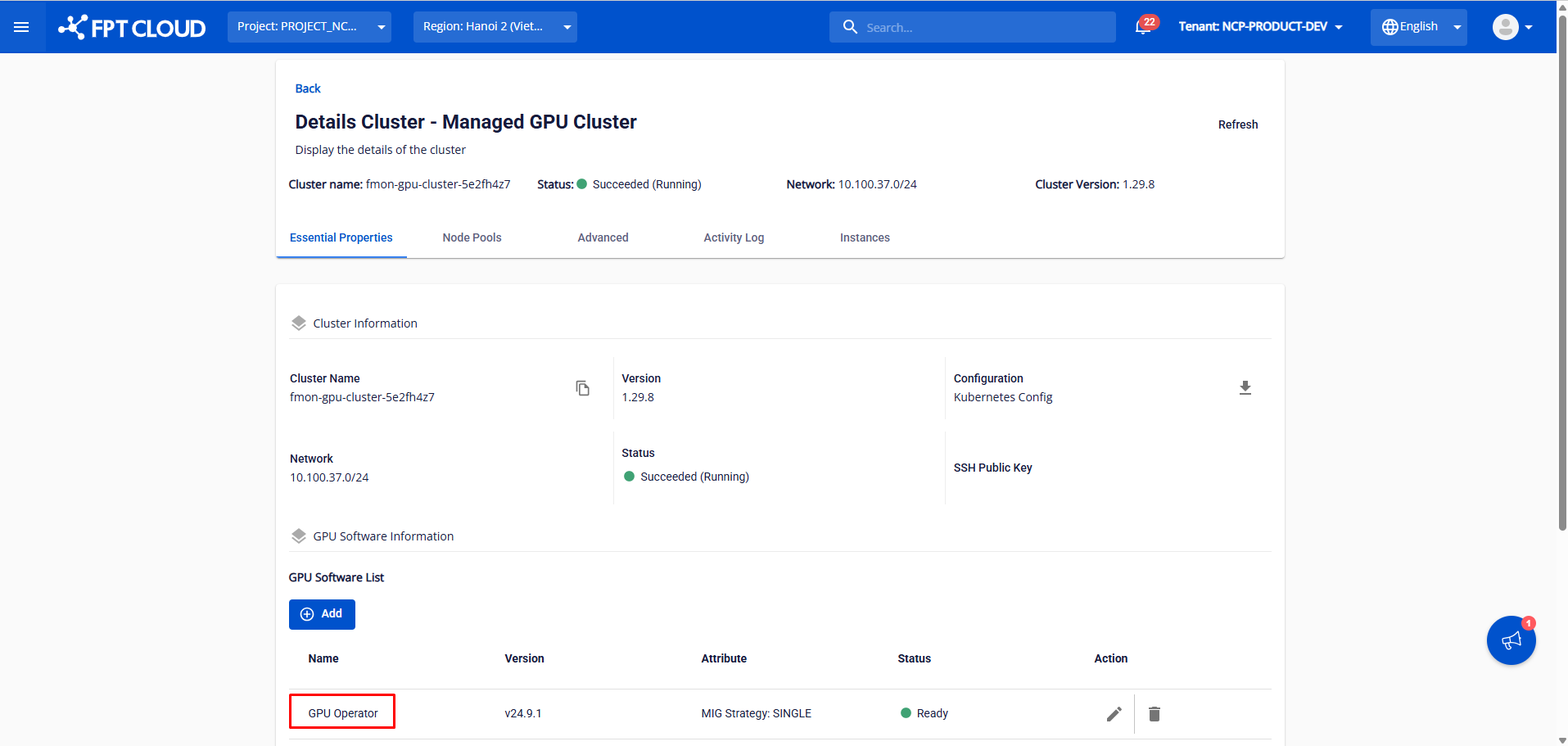

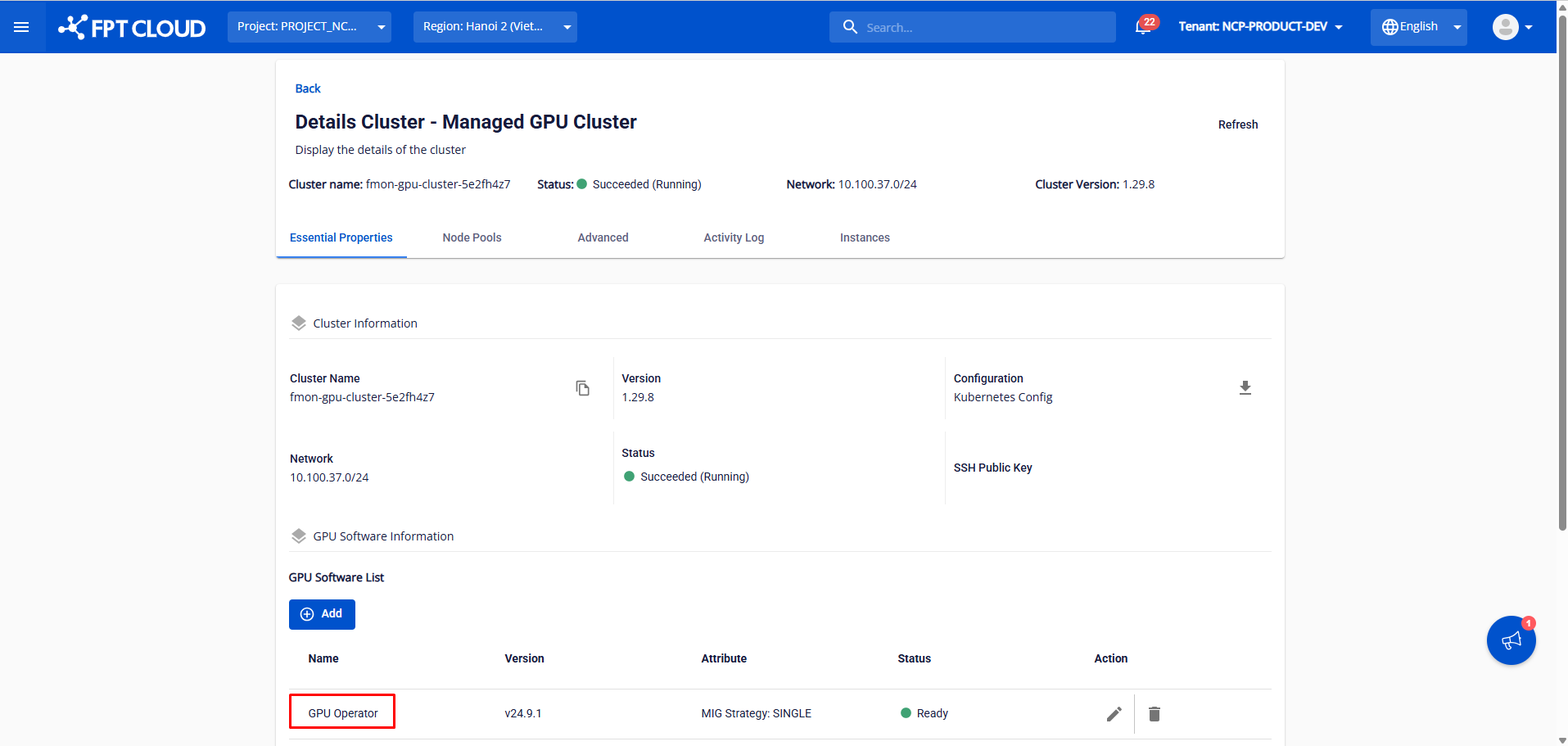

1.Yêu cầu tiên quyết

Bạn cần kích hoạt dịch vụ managed GPU cluster, có đủ quota storage, public IP, ... đủ để khởi tạo một cụm FPT managed GPU cluster.

GPU operator được cài đặt trên cluster.

Worker group sử dụng Pre-installed driver hoặc đã được cài driver thủ công.

Worker group thuộc loại GPU worker group.

Bạn có thể kích hoạt tính năng time-sharing trên mọi GPU mà chúng tôi cung cấp.

2.Hướng dẫn cài đặt

Bước 1: Cài đặt GPU operator tại phần cài đặt GPU software & chờ cho đến khi trạng thái GPU operator ở trạng thái ready.

Bước 3: verify phần cài đặt time slicing

Kubectl describe nodes Output:

Giải thích:

-Có tổng cộng 8 GPU trên node, mỗi GPU được cấu hình timeslicng với tối đa 10 container có thể kết nối đến, do vậy giá trị ở phần Allocatable của mục nvidia.com/gpu là 8 * 10 = 80.

Bước 4: deploy workload mẫu trên kubernetes sử dụng tính năng timeslicing

apiVersion: apps/v1

kind: Deployment

metadata:

name: vllm-gpt2

spec:

replicas: 1

selector:

matchLabels:

app: vllm-gpt2

template:

metadata:

labels:

app: vllm-gpt2

spec:

containers:

- name: vllm

image: vllm/vllm:latest

args:

- --model=gpt2

- --tensor-parallel-size=1

- --port=8000

ports:

- containerPort: 8000

resources:

limits:

nvidia.com/gpu: 1 # Require 1 GPU

restartPolicy: AlwaysKiểm tra log của pod vllm-gpt2

Kubectl logs Kết quả:

3.Sử dụng Timeslicing với MIG

Với tư cách là quản trị viên, bạn có thể muốn kết hợp nhiều tính năng sharing GPU của FKE. Tính năng GPU time-sharing có thể hoạt động cùng với MIG (multi-instance GPU), cho phép chia một GPU vật lý thành tối đa bảy phân vùng. Các phân vùng này được cách ly với nhau. Bạn có thể cấu hình tính năng GPU time sharing cho từng MIG instance.

Ví dụ, nếu bạn đặt giá trị MIG profile là 1g.10gb, GPU cơ bản sẽ được chia thành bảy phân vùng. Nếu bạn đồng thời đặt max-shared-clients là 3, thì mỗi phân vùng sẽ hỗ trợ tối đa ba container, tức là tổng cộng có thể có tối đa 21 thiết bị chia sẻ GPU có sẵn để phân bổ trên GPU vật lý đó. Để tìm hiểu cách gpu-partition-size chuyển đổi thành các phân vùng thực tế, hãy tìm hiểu về MIG.

Để kích hoạt tính năng GPU time sharing trên MIG instance, hãy chọn cả MIG và timeslicing trên màn hình chia sẻ worker group.

4.Hạn chế của Time slicing

Với cơ chế chia sẻ thời gian GPU (GPU time-sharing), giới hạn bộ nhớ không được áp dụng trên GPU. Để tránh gặp sự cố tràn bộ nhớ (OOM), bạn nên thiết lập giới hạn bộ nhớ GPU trong các workload của mình. Để tránh các vấn đề về bảo mật, chỉ triển khai các workload nằm trong cùng một ranh giới tin cậy khi sử dụng chia sẻ thời gian GPU.

Số lượng container tối đa có thể sử dụng chia sẻ thời gian trên một GPU vật lý là 48. Khi cài đặt cấu hình chia sẻ thời gian GPU, bạn nên cân nhắc đến nhu cầu tài nguyên của các workload và khả năng của GPU vật lý bên dưới để tối ưu hóa hiệu năng và độ phản hồi của hệ thống.